| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 | 31 |

- 리액트

- abex crackme

- 리버싱 문제

- html

- 보안

- writeup

- 해킹

- 인공지능

- 자바스크립트

- 웹해킹

- webhacking

- CodeEngn

- 리버싱

- 백준

- 알고리즘

- 리눅스

- 백준 알고리즘

- MySQL

- 어셈블리어

- php

- sql injection

- 웹

- C언어

- 워게임

- 컴퓨터 구조

- webhacking.kr

- 넘파이

- 머신러닝

- 회귀 수식

- 리버싱 워게임

- Today

- Total

로보틱스 연구일지

Downstream task에서 Pretraining model의 Fine-tuning이란? (vs. frozen) 본문

Fine-tuning은 Pretraining 이후, 기존 backbone(encoder) weight를 그대로 가져와서, downstream task를 학습할 때 weight를 계속 업데이트하는 과정이다.

그래서 Pretraining method를 제안하는 논문은, 그 방법론의 우수함을 입증하기 위해, 그 방법에 따라 생성한 pretrained weight를 backbone으로 다른 모델의 성능 개선 정도를 평가한다.

Pretrained model을 사용한 frozen, fine-tuning 실험이란 무엇인가..

Downstream task란 이렇게 학습한 모델 파라미터를 통해 다른 작업(e.g., navigation, classification)을 수행하는 것을 뜻한다.

이러한 Downstream task에서 간혹 pretrained weight를 backbone으로 받은 다른 모델에서 frozen, fine-tuning 실험을 한다.

Downstream task에서 Frozen과 Fine-tuned 실험이란?

- Frozen: backbone weight를 고정, 해당 task data로 추가 가중치 업데이트 안 함

- Fine-tuned: backbone weight를 초기값으로 설정 후, 해당 task data로 지속적인 가중치 업데이트를 통해 해당 task에 fine-tuning 된 모델을 생성 (== base model을 기반으로 깔되, 해당 task에 더 적합하도록 추가 학습시킨 모델을 생성)

예시 테이블에서, VANP extracted feature z_past는 downstream task에서 weight를 frozen 했을 때만 그대로 사용되고, fine-tuning시에는 weight가 업데이트되어서 pretraining 단계에서 뽑힌 context token z_past와는 다른 값임.

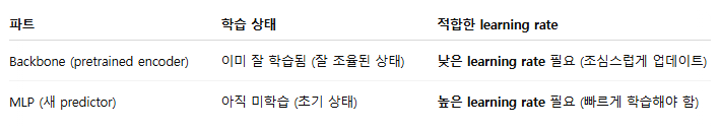

+backbone 모델과 downstream 모델 학습 시 적절한 learning rate

'인공지능 연구' 카테고리의 다른 글

| 모델 학습용 데이터셋 vs 벤치마크 데이터셋 (2) | 2025.05.11 |

|---|---|

| Object Goal Navigation 연구의 주요 목적과 데이터셋 (Gibson, MP3D, HM3D) (6) | 2025.05.11 |